Вчера мы с вами предметно поговорили о том, как высокие технологии сегодняшнего дня помогают создателям контента по всему миру с каждым разом удивлять своих зрителей все больше. Но у любой монеты есть две стороны, и то, что одни используют во благо, другие с неменьшим успехом могут превращать в оружие.

В финале своего выступления уже знакомый вам Дев Сен привел в пример известный ролик, в котором режиссер Джордан Пил превратился в Барака Обаму, обзывающего Дональда Трампа засранцем:

Это видео было создано с помощью программы Fakeapp и графического редактора Adobe After Effects. Таким образом Пил и журналисты хотели показать, куда уже в ближайшее время могут завести фейковые новости, а Сен - донести до гостей KYIV MEDIA WEEK, что искусственный интеллект (далее - ИИ) и машинное обучение (далее - МО) не всегда используются людьми с благими намерениями.

Впрочем, на «темной» стороне силы технологий он не очень-то задерживался, поэтому вчерашний материал был по большей части джедайским. А вот гендиректор CG Event Сергей Цыпцын, выступавший на KMW двумя днями позже, полностью сконцентрировался на опасностях, которые таят в себе ИИ и МО, а также предсказал проблемы, с которыми, вполне возможно, нам с вами предстоит столкнуться уже в самом ближайшем будущем. Об этом сегодня и поговорим.

Конечно, Сергей себе не враг, так что пугать слушателей с первых же минут он не стал. Сперва - немного общей информации, дабы легче было понять, что происходит. «Сначала человечество смотрело кино с расстояния 20 метров, затем появились домашние телевизоры, которые разместились в трех метрах он нас. Контент становился все ближе, и сегодня самые смелые его потребители надевают шлемы виртуальной реальности», - издалека начал Цыпцын.

Высказав предположение, что рано или поздно к аудиовизуальной отрасли подключатся фармакологи («Они могли бы создавать, например, специальные напитки, воздействующие на наши нейроны, чтобы картинки в кино были ярче и живее»), Сергей подвел к тому, что на сегодняшний день эту функцию взял на себя ИИ.

«Раньше у нас были фильмы, которые рассказывали истории, а теперь, готов спорить, вы даже не сможете вспомнить, о чем были четвертые «Трансформеры». Говоря проще, появилась форма без сути, а кинокартины превратились в аттракцион, который просто развлекает зрителя», - пессимистично отметил спикер.

Впрочем, эту проблему оставим кинокритикам, сокрушающимся по поводу засилья в кинотеатрах блокбастеров: Сергей привел данный пример лишь для демонстрации того, насколько неотъемлемой частью кинопроизводства стали высокие технологии. Ну а раз это произошло, то и нейросети не могли остаться в стороне создания аудиовизуального контента. И вот здесь остановимся подробнее.

Для начала Цыпцын рассказал о нескольких кейсах позитивных коллабораций в отраслях. Так, ничего плохого нет ни в ротоскопинге (когда нейросеть анализирует изображения и «отрезает» фон, оставляя лишь героев или другие нужные вещи на переднем плане), ни в проекте Cardinal (разработка Disney, которая умеет превращать текст в изображение). По словам Сергея, все это – примеры «помогающего» ИИ, который с каждым годом работает все совершеннее и в теории действительно может взять на себя большой кусок работы, чтобы люди сосредоточились на творчестве.

В копилку полезностей можно отнести и алгоритм StyleGAN, разработанный компанией Nvidia: с его помощью нейросети обучаются генерировать лица несуществующих людей. Поначалу «синтетические» изображения больше пугали, чем привлекали, однако конечный результат заметно улучшился после того, как нейросети «скормили» около 30 тысяч фотографий знаменитостей - сгенерированные снимки тут же стали куда симпатичнее.

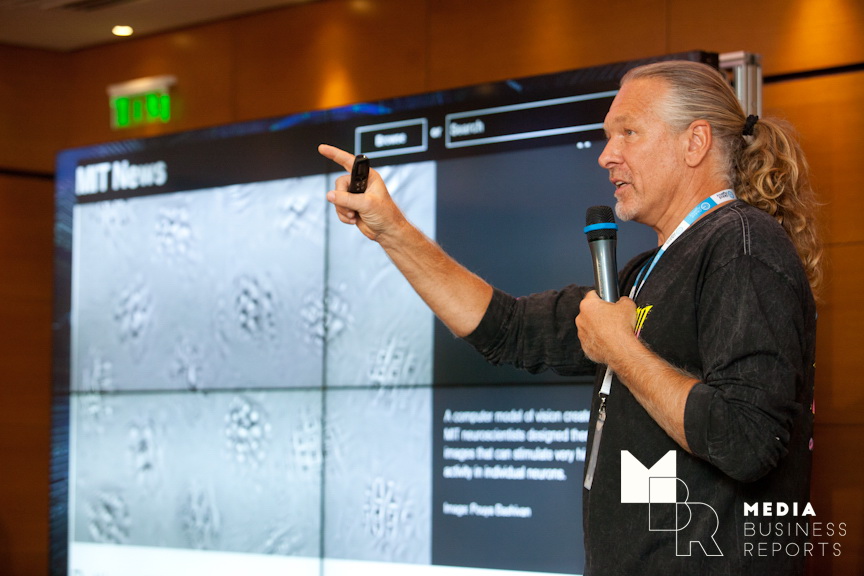

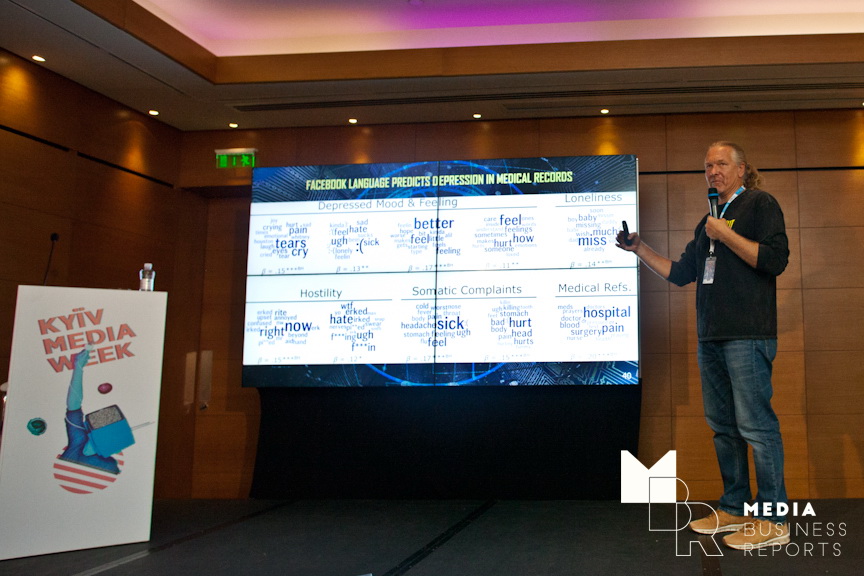

Еще один удачный кейс с использованием высоких технологий в целом и нейросетей в частности пришел к нам из медицины. Летом прошлого года команда ученых из MIT разработала компьютерную модель, способную не только диагностировать, а и предсказывать депрессию у человека на основании его постов в соцсетях. Похожий эксперимент, но уже в интересующей нас области создания контента, не так давно провели на платформе Vimeo: там нейросети анализировали и само видео, и комментарии пользователей под ним. Целью исследования была попытка определить маркеры, которые делают каждый конкретный ролик успешным у зрителей. Надо ли говорить, что эксперимент увенчался успехом?

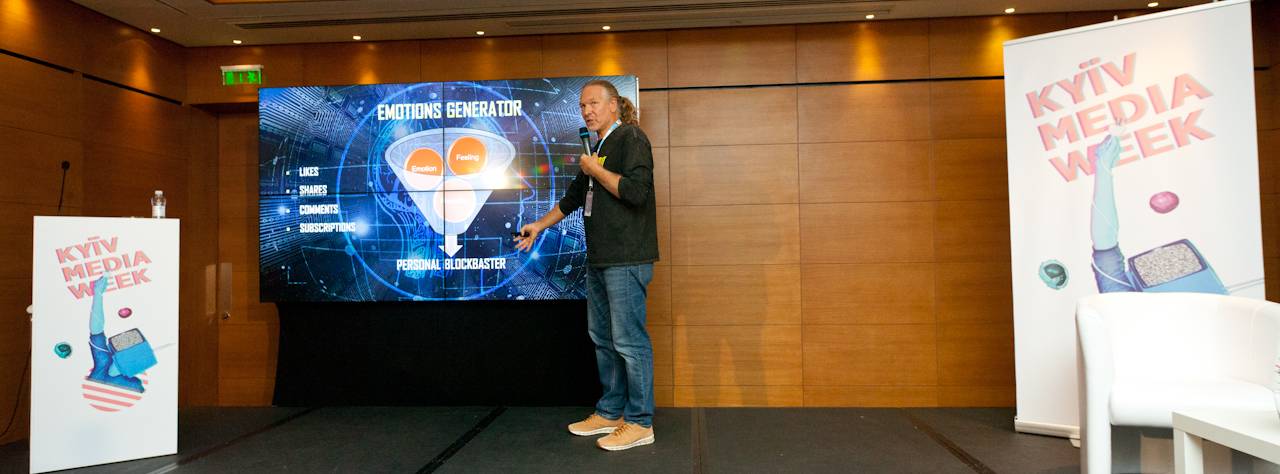

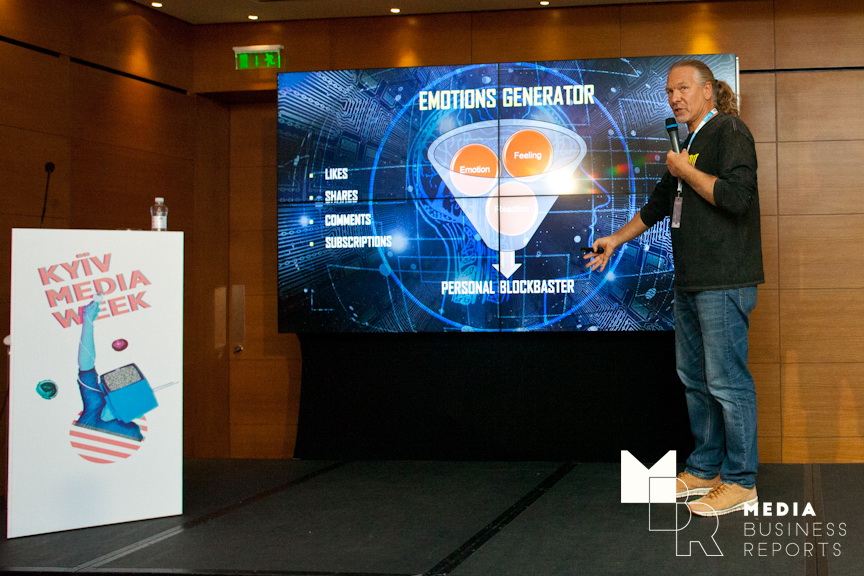

«Таким образом, теперь мы знаем, что с помощью ИИ можно создавать контент, который соберет много позитивного фидбека. В мыслях я пошел еще дальше: если, скажем, используя те же технологии, проанализировать лайки, комментарии, реакции и вообще весь цифровой след отдельного человека, то рано или поздно мы придем к тому, что можно будет сгенерировать личный блокбастер», - поделился размышлениями Цыпцын.

На примере «Трансформеров» Сергей уже продемонстрировал, что кинематограф давно сделал первые попытки воздействовать на зрителя формой без содержания. Но только представьте, куда все это может прийти, если мир действительно будет развиваться по озвученному Цыпцыным сценарию, а создавать каких-нибудь «Трансформеров-18» возьмется нейросеть.

По словам Сергея, наибольшая опасность кроется даже не в самом процессе, а в том, что если нейросети долго учить, то рано или поздно они сумеют создать контент, который не просто будет вызывать у людей нужные эмоции, но и вводить их в нужные состояния.

«Помните ролики, в которых коты пугаются огурцов? В их случае страх объяснялся тем, что кошки на генетическом уровне боятся змей, а огурцы на них похожи. У людей тоже есть целый список того, к чему мы относимся с опаской на подсознательном уровне, и когда-нибудь нейросети смогут это использовать», - объяснил свои переживания Цыпцын.

А теперь представьте, что однажды вы проснетесь в мире, где ИИ уже умеет создавать контент, вводящий зрителя в определенное состояние. Хорошо, если речь идет о чем-то позитивном. Но где гарантии, что такими технологиями не воспользуются злоумышленники, которые заведут вас в депрессию одним коротким роликом даже без вашего ведома? Вот об этом и беспокоится Сергей, а чтобы этого не случилось, уже сегодня он призывает задуматься о регуляции потребления синтетического контента.

«Искусственный интеллект - это черное зеркало обычного интеллекта», - мрачно резюмирует он.

Конечно, «темная» сторона силы технологий - совсем не повод от них отказываться. Более того, предупрежден - значит вооружен, а любое знание - само по себе сила. Не забывайте ею пользоваться, и тогда никакие ситхи вам не будут страшны.